はじめに:AIは「見る」から「洞察する」時代へ

2025年秋、OpenAIがついに待望の次世代モデル**「GPT-5」**をリリースしました。前モデルであるGPT-4o(Omni)が世界に衝撃を与えてから約1年半。私たちの手元に届いたこの新しいAIは、単なるスペックアップにとどまらない、質的な「進化」を遂げています。

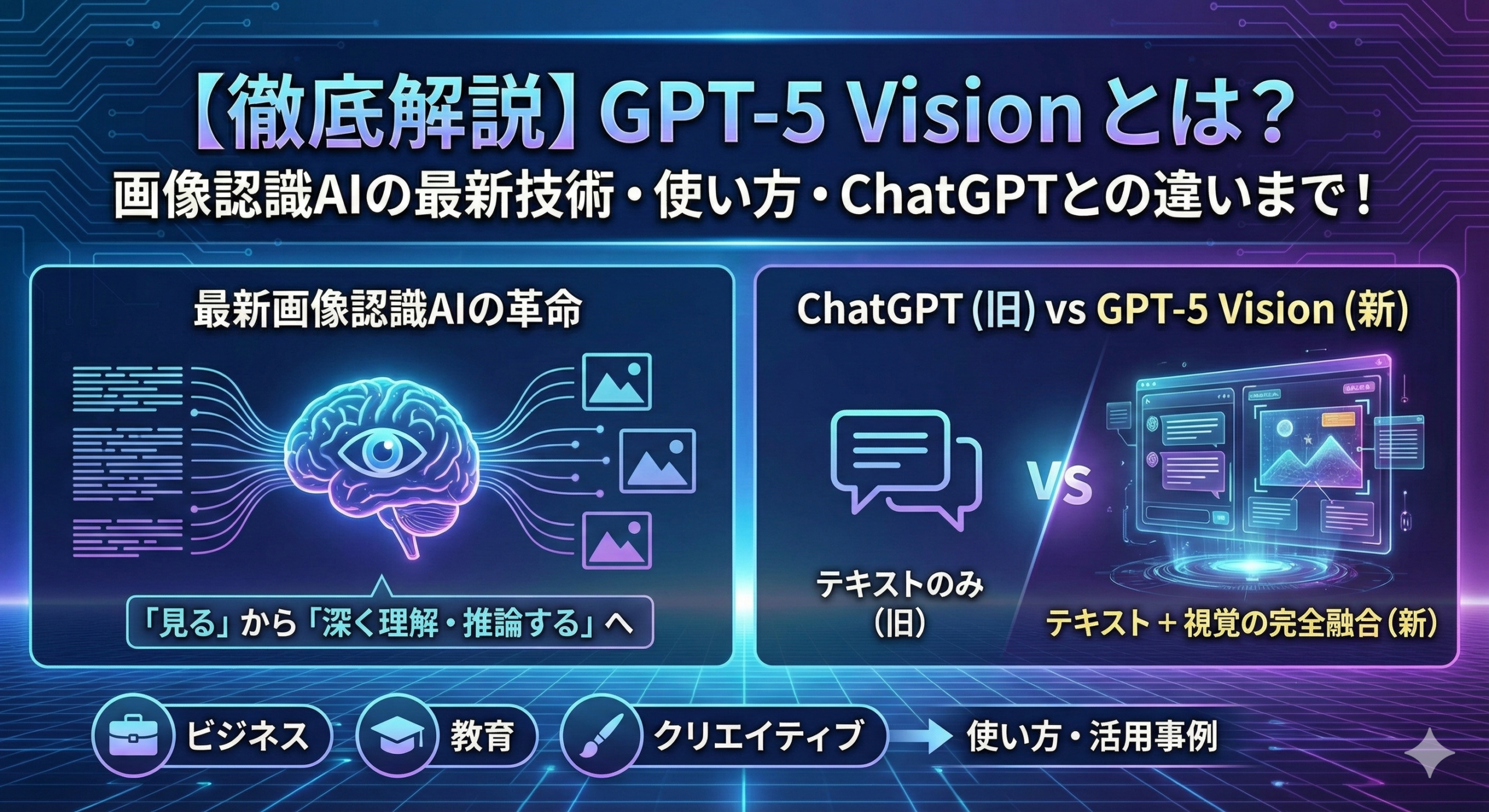

特に注目すべきは、画像認識能力(Vision機能)の劇的な深化です。

これまでのGPT-4oも画像を見ることはできましたが、GPT-5は画像を見て「推論」し、「物理法則を理解」し、そこから「未来を予測」する領域に達しました。

「画像認識なんてGPT-4でもできたじゃないか」

そう思う人こそ、この記事を読んでください。なぜ世界中の技術者やビジネスパーソンがGPT-5に熱狂しているのか。その理由は、解像度の違いではなく、**「認識の深さ(Deep Reasoning)」**にあります。

本記事では、GPT-5のVision機能の全貌、GPT-4oとの決定的な違い、そしてあなたの仕事や生活を変える具体的な活用法まで、徹底的に解説します。

第1章:GPT-5 Visionの正体|何が「革命的」なのか?

1. 「テキスト」と「視覚」の完全融合(ネイティブ・マルチモーダル)

従来のAI開発では、言語モデルと言語以外のモデル(画像処理など)をつなぎ合わせるアプローチが主流でした。しかし、GPT-5は設計段階から**「テキスト・画像・音声・動画」をすべて同じ一つの脳(ニューラルネットワーク)で処理する**ように作られています。

これにより、以下のような従来の弱点が克服されました。

- タイムラグの消失: 画像を見てから回答するまでの遅延が、人間が会話する速度と同等(数ミリ秒レベル)になりました。

- 文脈の超・理解: 画像内の小さな文字、背景にある物体の位置関係、光の当たり方から推測される時間帯など、人間でも見落とすような情報を統合して理解します。

2. 「Strawberry(o1)」レベルの推論能力を視覚に適用

2024年に先行公開された推論モデル「OpenAI o1(コードネーム:Strawberry)」の技術が、GPT-5のVision機能にも完全に統合されました。

これはどういうことかと言うと、**「AIが画像を見ながら、論理的に考え、検証してから答える」**ようになったということです。

- GPT-4oの場合: レントゲン写真を見て「影があります」と答える(パターン認識)。

- GPT-5の場合: 「影の位置と形状、患者の年齢データ(テキスト情報)を照らし合わせると、〇〇の可能性が高いが、アーチファクト(ノイズ)の可能性も棄却できないため、別角度の画像が必要です」と推論する(専門家レベルの診断補助)。

3. 動画・3D空間認識への対応

GPT-5 Visionの最大の特徴は、静止画だけでなく**「動画ストリーム」や「3D空間」の理解**に長けている点です。

スマホのカメラを通して部屋全体を映すと、GPT-5は家具の配置を3Dで把握し、「このソファはあそこのドアを通らない可能性があります」といった物理的なアドバイスまで可能にしました。

第2章:徹底比較|GPT-4o vs GPT-5

「結局、課金してアップグレードする価値はあるの?」

この疑問に答えるために、両モデルの決定的な違いを表にまとめました。

| 比較項目 | GPT-4o (2024) | GPT-5 (2025最新) | 進化のポイント |

| 画像認識精度 | 物体・文字の特定は得意 | 文脈・感情・意図まで理解 | 「何が写っているか」だけでなく「なぜそうなのか」を理解する |

| 空間認識能力 | 2次元的(平面として見る) | 3次元的(奥行き・物理法則) | 設計図や家具配置、AR用途で実用レベルに到達 |

| 手書き文字読解 | 綺麗な字なら高精度 | 癖字・崩し字・古文書も可能 | 医師のカルテや歴史的資料の解読が可能に |

| 動画理解 | 短いクリップの分析 | リアルタイムストリーミング | 防犯カメラの監視や、スポーツの実況解説が可能 |

| 推論速度 | 高速だが、複雑な問いに浅い | 思考時間を調整し深く考える | 「System 2(熟考)」思考を視覚情報に適用 |

| 幻覚(ハルシネーション) | 画像の詳細を捏造することがある | 大幅に低減(事実確認機能) | Web検索と視覚情報を突き合わせる機能が強化 |

結論: 日常会話や簡単な写真描写ならGPT-4oで十分です。しかし、**「分析」「業務効率化」「クリエイティブ制作」**に使うなら、GPT-5は必須のツールと言えます。

第3章:ビジネスが変わる!GPT-5 Visionの業界別活用事例

GPT-5の登場により、これまで「人間の目」が必要だった業務の多くが自動化・効率化されつつあります。

1. EC・マーケティング業界

- 商品ページの自動生成: 商品の写真を1枚アップロードするだけで、GPT-5が「SEOに強いタイトル」「魅力的な商品説明文」「Instagram用のハッシュタグ」「仕様スペック表」をすべて出力します。

- 競合分析: 店頭の棚の写真を撮るだけで、「競合他社の陳列シェア」「パッケージデザインのトレンド」「欠品状況」を瞬時にレポート化します。

2. IT・エンジニアリング

- UI/UXの改善提案: アプリのスクリーンショットや手書きのワイヤーフレームを見せるだけで、「ユーザー導線の問題点」を指摘し、修正後のコード(React/Vueなど)を生成します。

- デバッグ作業: エラー画面のキャプチャを投げると、ログを解析せずとも視覚情報からエラーの原因(CSS崩れやレンダリングエラー)を特定します。

3. 製造・建設業

- 安全確認の自動化: 現場の写真を解析し、「ヘルメット未着用の作業員がいる」「資材の置き方が崩落の危険がある」といったリスクを瞬時に検知・報告します。

- 図面のデジタル化: 紙の設計図面をスキャンするだけで、CADデータへの変換補助や、部材リスト(BOM)の作成を行います。

4. 教育・研究

- 数式の理解と解説: ホワイトボードに書かれた複雑な数式や化学構造式を写真に撮ると、LaTeX形式への変換だけでなく、「ここからどう変形すれば解けるか」というヒントをステップバイステップで解説します。

第4章:【実践編】GPT-5 Visionを使いこなす「プロンプト」の極意

高性能なエンジンも、使い方が悪ければ性能を発揮できません。GPT-5の視覚能力を120%引き出すための「プロンプト(指示文)」のテクニックを紹介します。

テクニック①:役割を与える(ロールプレイ)

ただ「この画像を見て」と言うのではなく、「誰の目線で見るか」を指定します。

悪い例:

「この部屋の画像を分析して。」

良い例(インテリアデザイナー編):

「あなたは世界的なインテリアデザイナーです。このリビングの写真を分析し、今の家具配置のままで『部屋を広く見せる』ための改善案を3つ提案してください。配色の観点も含めてください。」

テクニック②:フォーカスポイントを指定する

GPT-5は画像全体を詳細に見すぎる傾向があります。注目すべき場所を言葉で指定しましょう。

プロンプト例:

「添付の契約書の画像の、第3条と第5条の条文に注目してください。この内容は、借主にとって法的に不利な条件が含まれていますか?リスクを箇条書きで洗い出してください。」

テクニック③:マルチショット推論(Chain of Thought)

複雑な作業は、一度に答えを出させず、段階を踏ませます。

プロンプト例(料理のレシピ考案):

「冷蔵庫の中身の写真を送ります。以下の手順で回答してください。

- 画像に写っている食材をすべてリストアップする。

- その中から、賞味期限が近そうな野菜(しなびているもの)を優先的に使う判断をする。

- それらの食材を使って、20分以内に作れる『和食』のレシピを考案する。」

第5章:セキュリティとプライバシーへの懸念

「画像をAIに見せる」ことには、当然リスクも伴います。OpenAIはGPT-5において、以下の安全対策を強化しています。

1. 個人情報のマスキング

人物の顔(特に著名人ではない一般人)や、クレジットカード番号、住所などの機微な情報が含まれる画像がアップロードされた場合、GPT-5は自動的にボカシ処理を行うか、識別を拒否するガードレールが設定されています。

2. 学習への利用設定

企業ユーザー向け(ChatGPT Enterprise / Teamプラン)では、アップロードした画像やデータがAIの学習に使われないことが保証されています。個人ユーザー(Plusプラン)の場合も、設定(Settings > Data Controls)から学習をオフにすることが可能です。機密情報を扱う場合は、必ずこの設定を確認しましょう。

3. ディープフェイク対策

GPT-5は画像を生成することも可能ですが、実在の人物のフェイク画像や、暴力的・性的な画像の生成は厳格にブロックされています。また、AIが生成した画像には、目に見えない電子透かし(Watermark)が埋め込まれる国際標準に対応しました。

第6章:競合AIとの比較|Gemini、Claudeはどう動く?

2025年現在、画像認識AIは群雄割拠の時代です。GPT-5のライバルたちと比較してみましょう。

- Google Gemini 2.0 (Ultra):YouTube動画の解析や、Google Workspace(ドキュメント、スプレッドシート)との連携においては依然として最強です。「動画の中から特定のシーンを探す」といったタスクではGPT-5を凌駕する場合があります。

- Anthropic Claude 3.5 Opus:長文読解とコーディングに強みがありましたが、視覚認識においては「グラフやチャートの数値読み取り」の精度が非常に高いのが特徴です。学術論文の図表解析などでは、GPT-5と互角以上の戦いを見せます。

選び方の基準:

- 総合力・クリエイティブ・対話: GPT-5

- Googleエコシステム・動画解析: Gemini

- 長文・厳密なデータ読み取り: Claude

まとめ:GPT-5 Visionは「第二の脳」となる

GPT-5 Visionの登場によって、AIは単なる「検索ツールの延長」から、**「物理世界を理解し、一緒に作業してくれるパートナー」**へと進化しました。

- 見る(Vision)

- 考える(Reasoning)

- 提案する(Generation)

この3つのサイクルが超高速で回ることで、あなたの生産性は飛躍的に向上します。

「まだAIに画像を見せたことがない」という人は、今すぐ手元のスマホで写真を撮り、ChatGPTに送ってみてください。「この植物の名前は?」「この英語メニューの意味は?」「この配線のつなぎ方は合ってる?」

その瞬間、あなたは未来の便利さを体験することになるでしょう。

2026年に向けて、この技術はさらに「ARグラス」や「ロボット」へと実装されていきます。今、GPT-5を使いこなすことは、来るべきAI共生時代へのパスポートを手に入れることと同義なのです。

コメント